融合邊緣信息的顯著性目標(biāo)檢測

蘇文強(qiáng),王永雄

(上海理工大學(xué) 光電信息與計(jì)算機(jī)工程學(xué)院,上海 200093)

1 引 言

顯著性目標(biāo)檢測(Salient Object Detection,SOD)旨在識(shí)別圖像或視頻中最具視覺吸引力的物體或部件,廣泛應(yīng)用于計(jì)算機(jī)視覺的預(yù)處理過程,比如視頻檢測[1],視覺跟蹤[2]和圖像分割[3,4]等.

在過去數(shù)十年中,研究人員提出了數(shù)百種基于簡單特征的SOD方法(例如顏色[5],紋理[6]和對(duì)比度[7]).這些方法難以獲得上下文語義信息,限制了它們在復(fù)雜場景中的應(yīng)用.近年來,隨著深度學(xué)習(xí)技術(shù)的突破和發(fā)展,全卷積網(wǎng)絡(luò)(FCN)[8]已經(jīng)顯示出強(qiáng)大的特征提取能力,促進(jìn)了顯著性目標(biāo)檢測(SOD)的發(fā)展.FCN網(wǎng)絡(luò)模型可以提取多層特征信息,包括低層的局部細(xì)節(jié)信息和高層的語義信息.現(xiàn)如今大多數(shù)主流的顯著性檢測方法都是使用FCN網(wǎng)絡(luò),基于FCN的SOD模型大多采用編解碼架構(gòu),編碼模塊由預(yù)訓(xùn)練好的骨干網(wǎng)絡(luò)(Vgg16或Resnet)組成,憑借其強(qiáng)大特征提取能力使得模型獲得豐富而穩(wěn)定的多層特征信息.而在解碼階段,低層的局部細(xì)節(jié)信息和高層的語義信息充分融合,獲得準(zhǔn)確的顯著圖.其中特征層間的信息進(jìn)行有效融合通常是比較困難的,很多研究者在融合層間特征這方面做了深入研究[9-14].盡管SOD在FCN推動(dòng)下取得了巨大的進(jìn)展,然而在前景與背景對(duì)比度較低的圖片以及圖片的邊緣細(xì)節(jié)區(qū)域仍然存在檢測誤差.為了解決這一問題,一些研究者嘗試使用更深的網(wǎng)絡(luò)提取信息[14],一些則采用復(fù)雜的方式融合不同特征層特征信息[11].研究人員嘗試后發(fā)現(xiàn),增加深度和改進(jìn)特征層融合方式很難提升圖像邊緣和低對(duì)比度區(qū)域的顯著性檢測效果.這可能是因?yàn)樵陲@著性信息逐層傳遞的過程中,邊緣細(xì)節(jié)信息沒有得到充分關(guān)注,限制了顯著性結(jié)果的準(zhǔn)確率.一些研究員嘗試引入邊緣信息提升顯著圖的準(zhǔn)確率[15-18].通過引入邊緣信息進(jìn)行監(jiān)督使得顯著性檢測模型取得不錯(cuò)效果.

由于邊緣信息和非邊緣信息的像素點(diǎn)分布處于不平衡的狀態(tài).簡單的將邊緣信息和非邊緣信息進(jìn)行融合,取得的效果很難得到一個(gè)令人滿意的結(jié)果,簡單的將邊緣用于監(jiān)督學(xué)習(xí)也可能會(huì)得到模型的次優(yōu)解.Poolnet[14](CVPR2019)是近年來顯著性檢測的經(jīng)典方法之一.通過充分融合層間特征信息取得了不錯(cuò)的效果,其FAM模塊將全局引導(dǎo)信息池化為不同尺度特征圖再上采樣回該層特征圖大小后疊加處理,疊加后的特征包含豐富多尺度信息,放大了整個(gè)網(wǎng)絡(luò)的感受野.此外簡單上采樣容易引入噪聲干擾,多尺度的融合可以減少這類噪聲干擾,從而取得較好的檢測效果.但盡管如此,該方法在圖像的邊緣處和顯著性目標(biāo)的邊緣區(qū)域仍然存在一些誤檢測的地方.SCRN[16](ICCV2020)利用邊緣信息監(jiān)督輔助訓(xùn)練網(wǎng)絡(luò),實(shí)驗(yàn)結(jié)果表明對(duì)比僅靠融合層間信息的PoolNet網(wǎng)絡(luò),融合邊緣信息后使得模型的邊緣信息充分補(bǔ)充,邊緣處細(xì)節(jié)處也更加清晰完整,整體效果得到提升.SCRN生成的顯著圖相比Poolnet雖然在邊緣細(xì)節(jié)區(qū)域取得了一定進(jìn)展,但仍然存在少許誤檢測區(qū)域,這可能是邊緣信息自身的數(shù)據(jù)分布不平衡導(dǎo)致的.SCRN通過對(duì)真值圖邊緣檢測得到圖片的邊緣信息,然后將邊緣信息用以監(jiān)督網(wǎng)絡(luò)學(xué)習(xí).SCRN網(wǎng)絡(luò)僅僅使用了邊緣部分少數(shù)像素點(diǎn),忽略了邊緣周圍的像素點(diǎn),這會(huì)導(dǎo)致邊緣信息的數(shù)據(jù)分布不均勻,邊緣像素點(diǎn)和非邊緣像素點(diǎn)的不平衡可能會(huì)導(dǎo)致模型學(xué)習(xí)困難.

邊緣信息在顯著性檢測中扮演重要作用,僅僅依靠層間特征融合,會(huì)在融合過程中弱化特征圖中的邊緣信息,使模型得到次優(yōu)解.基于此,研究者們曾提出結(jié)合邊緣信息的顯著性檢測模型[15-19].然而這些設(shè)計(jì)的模型中一部分只使用了單分支網(wǎng)絡(luò)[9],即在淺層信息中提取邊緣信息,在深層特征中提取顯著性信息.這種單分支的網(wǎng)絡(luò)很難同時(shí)學(xué)習(xí)到豐富的邊緣信息與顯著性信息,對(duì)于邊緣信息與顯著性信息的融合不夠充分.不同于單分支網(wǎng)絡(luò),一些模型[17]提出了雙分支網(wǎng)絡(luò),雙分支分別學(xué)習(xí)邊緣信息和顯著性信息,每一個(gè)分支有自己獨(dú)立的編解碼模塊,通過顯著性信息與邊緣信息之間逐層交互,獲得更加準(zhǔn)確地顯著圖.然而這種獨(dú)立的編碼網(wǎng)絡(luò)增加了計(jì)算量,帶來了冗余信息.最新的網(wǎng)絡(luò)[16,19]選擇共享編碼和部分解碼網(wǎng)絡(luò),并取得了不錯(cuò)的效果.基于此,本文提出了一個(gè)全新的包含邊緣信息引導(dǎo)的雙分支網(wǎng)絡(luò),其可以有效地檢測圖像中低對(duì)比度區(qū)域和邊緣區(qū)域的顯著性目標(biāo).

受雙分支網(wǎng)絡(luò)近來的研究啟發(fā),本文設(shè)計(jì)了一個(gè)包含顯著性檢測子網(wǎng)絡(luò)和邊緣檢測子網(wǎng)絡(luò)的雙分支網(wǎng)絡(luò)模型,邊緣信息和顯著性信息在網(wǎng)絡(luò)中逐層融合.在顯著性檢測子網(wǎng)絡(luò)中,真值圖作為標(biāo)簽對(duì)最終生成的顯著圖監(jiān)督學(xué)習(xí),其中著性檢測子網(wǎng)絡(luò)的輸出也是推導(dǎo)階段整個(gè)網(wǎng)絡(luò)模型的最終輸出.相對(duì)應(yīng)的邊緣檢測子網(wǎng)絡(luò),由真值圖通過距離變換后得到的邊緣真值圖進(jìn)行監(jiān)督,學(xué)習(xí)目標(biāo)的邊緣信息.為了充分交互不同特征層的邊緣信息與顯著性信息,本文設(shè)計(jì)了信息交互模塊(Information Exchange Model,IEM),使得邊緣信息可以對(duì)顯著性信息進(jìn)行細(xì)節(jié)處的補(bǔ)充,也使得顯著性信息可以對(duì)邊緣信息進(jìn)行語義上的引導(dǎo).為了引導(dǎo)信息流的自頂向下的傳遞同時(shí)在信息傳遞中融合全局語義信息和IEM輸出的信息,本文設(shè)計(jì)了特征融合模塊(Feature Fusion Model,FFM).受金字塔池化模塊[14,20]的啟發(fā),在FFM內(nèi)部添加了多尺度的交互模塊,使得融合后的層內(nèi)特征可以捕捉到不同尺度信息.雙分支網(wǎng)絡(luò)中的邊緣檢測子網(wǎng)絡(luò)只在訓(xùn)練過程中參與,不參與推理階段計(jì)算,減少了模型的計(jì)算量.本文利用IEM和FFM模塊搭建了全新的網(wǎng)絡(luò)模型,使得網(wǎng)絡(luò)不僅充分融合了特征層間顯著性信息與邊緣信息,也學(xué)習(xí)豐富的特征層內(nèi)多尺度信息.本文所提出的方法從層間和層內(nèi)兩個(gè)維度出發(fā),提高了網(wǎng)絡(luò)的整體性能,并且在邊緣細(xì)節(jié)處取得了非常明顯的提高.

2 相關(guān)研究

過去的幾十年間,大量傳統(tǒng)的方法應(yīng)用在顯著性檢測中,這些方法大多利用圖片的固有屬性,如色彩[5],圖片紋理[6],對(duì)比度[7]和中心先驗(yàn)[21]等去提取特征信息.然而,這些方法過多關(guān)注低層信息,難以捕捉高層語義關(guān)系,影響了在復(fù)雜場景中的應(yīng)用.近年來,基于深度學(xué)習(xí)的網(wǎng)絡(luò)模型取得了顯著的效果,而其主要被分成兩種方向,一種是基于特征融合的網(wǎng)絡(luò)模型,另一種則是引入邊緣信息的網(wǎng)絡(luò)模型.

2.1 基于特征融合的模型

近年來,全卷積網(wǎng)絡(luò)(FCN)[8]一直被用來提取多特征層間的信息,整合多層間的特征信息生成顯著性圖取得了不錯(cuò)的效果.隨著研究的深入,研究人員發(fā)現(xiàn)融合來自不同特征層間的信息會(huì)產(chǎn)生較好的結(jié)果.于是越來越多的方法從融合多層特征的角度出發(fā),推動(dòng)了計(jì)算機(jī)視覺在顯著性檢測方向的發(fā)展.盡管通過FCN提取的多層特征包含了豐富的高層語義信息和低層細(xì)節(jié)信息,但由于空間分辨率逐層降低使得部分層間特征信息不準(zhǔn)確.因此如何融合層間信息成為了研究者們關(guān)注的主要方向.大多數(shù)基于特征融合的模型采用編解碼的結(jié)構(gòu),其中編碼部分往往提取多尺度特征信息,解碼模塊一般是利用不同特征層的上下文信息充分融合特征.Hou[22]引入了在全卷積網(wǎng)絡(luò)中進(jìn)行短連接,去融合不同層間的信息.Deng[23]和Wang[24]采用迭代策略,利用深層和淺層的特征,逐步細(xì)化顯著性圖.Yue[12]基于不同特性的檢測結(jié)果,融合多個(gè)單尺度顯著圖生成最終顯著圖.Chen[13]提出了融合上下文信息的多尺度圖像顯著性檢測算法.Liu[25]建議關(guān)注每個(gè)像素的上下文區(qū)域,這對(duì)抑制背景噪聲的干擾可能會(huì)有所幫助.Chen[26]注意力機(jī)制引導(dǎo)網(wǎng)絡(luò)選擇特征,并將其集成生成顯著性圖.Zhang[27]設(shè)計(jì)了一個(gè)雙向信息傳遞模型為了更好的特征選擇和集成.Liu[28]利用池化和特征融合模塊構(gòu)建高性能的模型.Zhao[29]介紹了信道注意和空間注意,以提取有價(jià)值的特征和抑制背景噪聲.Pang[11]認(rèn)為相鄰特征層具有更接近的抽象特征并基于此設(shè)計(jì)了MINet進(jìn)行相鄰特征層間特征信息融合.上述方法主要依賴圖像局部區(qū)域信息和全局上下文信息融合,通過全連接網(wǎng)絡(luò)進(jìn)行顯著性目標(biāo)檢測,而且編碼器與解碼器之間引入了復(fù)雜的模塊帶來了較高的計(jì)算成本,冗余信息更容易傳遞到解碼模塊,使得模型獲得次優(yōu)解.

2.2 基于邊緣信息的模型

基于特征融合的SOD模型取得了不錯(cuò)的效果,但特征融合在復(fù)雜場景中很難完整的分割出目標(biāo)精細(xì)的邊緣.引入邊緣信息作為輔助標(biāo)簽監(jiān)督網(wǎng)絡(luò)學(xué)習(xí),提高了SOD的檢測效果.Zhao[15]提出的Egnet將目標(biāo)邊緣特征與顯著性特征相互融合互補(bǔ),利用邊緣信息構(gòu)建二元交叉熵作為損失函數(shù)監(jiān)督模型學(xué)習(xí)邊緣信息,強(qiáng)調(diào)了邊緣信息的重要性.Qin[17]提出的Basnet構(gòu)造了一種兩階段的細(xì)化編碼解碼網(wǎng)絡(luò)模型,從像素點(diǎn)級(jí),patch級(jí)別和圖級(jí)3個(gè)不同尺度設(shè)計(jì)復(fù)合損失函數(shù)監(jiān)督網(wǎng)絡(luò)學(xué)習(xí).Li[30]提出C2snet網(wǎng)絡(luò)使用雙分支網(wǎng)絡(luò)同時(shí)生成邊沿信息和顯著圖,兩分支交互學(xué)習(xí),訓(xùn)練好的網(wǎng)絡(luò)可以通過檢測輪廓生成最終顯著圖.

近年來的相關(guān)研究表明顯著性檢測在顯著性信息與邊緣信息的融合上有一定研究意義.受以上方法的啟發(fā),本文提出了一種包含雙分支網(wǎng)絡(luò)的顯著性目標(biāo)檢測模型.雙分支網(wǎng)絡(luò)結(jié)構(gòu)包含邊緣檢測子網(wǎng)絡(luò)和顯著性檢測子網(wǎng)絡(luò),通過IEM,逐層融合顯著性信息與邊緣信息,在不同特征層特征信息融合的同時(shí),主動(dòng)增強(qiáng)對(duì)邊緣信息的學(xué)習(xí),減少邊緣信息在自頂向下過程中被弱化的問題,同時(shí)設(shè)計(jì)FFM聚合層間特征并利用全局引導(dǎo)模塊(Global Guidance Module,GGM)中的全局信息強(qiáng)化信息流中的高級(jí)語義信息.大量實(shí)驗(yàn)表明本文的網(wǎng)絡(luò)模型在主流的檢測方法中取得了不錯(cuò)效果.

3 本文方法

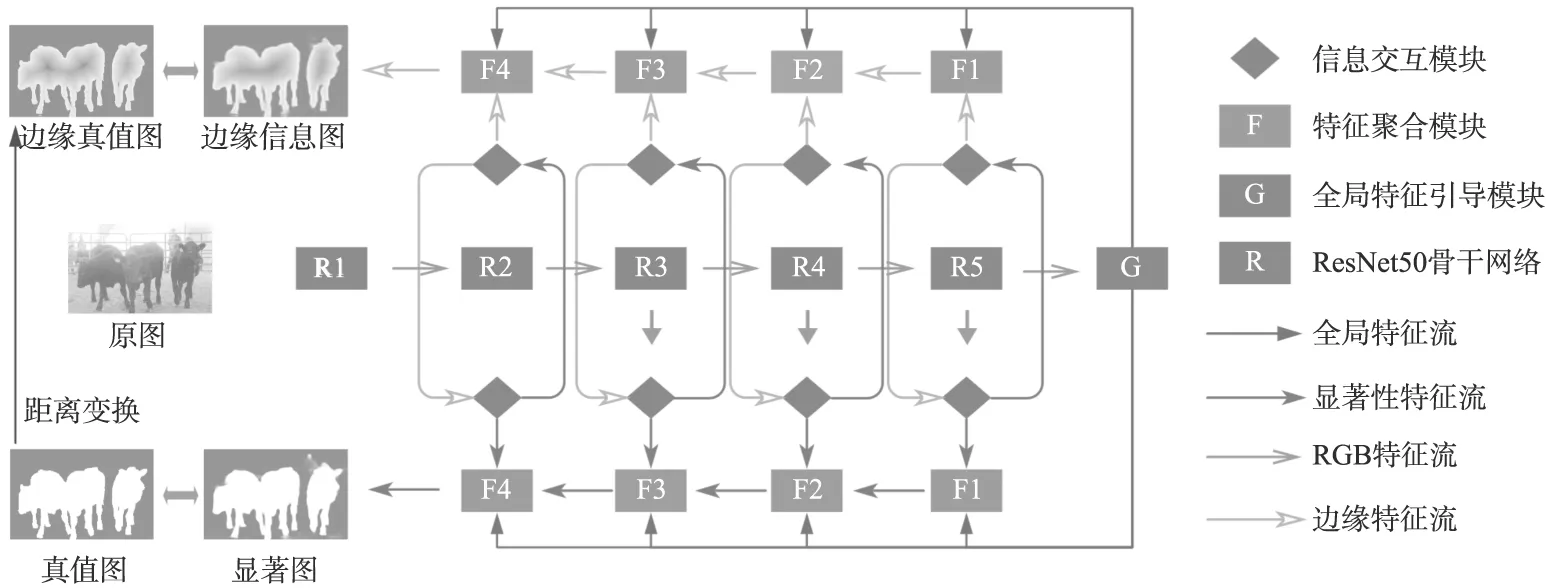

本文提出了一種全新的顯著性檢測網(wǎng)絡(luò)模型,包括兩個(gè)逐層特征融合的子網(wǎng)絡(luò):提取邊緣信息的邊緣檢測子網(wǎng)絡(luò)和最終生顯著圖的顯著性檢測子網(wǎng)絡(luò).模型的主干網(wǎng)絡(luò)是Resnet-50,在自頂向下的傳遞過程中,特征信息逐層融合,邊緣信息和顯著性信息交互融合.如大多數(shù)論文中所述[14,19],第一層特征圖的特征信息引入了大量計(jì)算且對(duì)模型性能提升微弱,所以本文和研究者們做法一樣選擇忽略該層特征信息.模型整體結(jié)構(gòu)如圖1所示.

圖1 模型整體框架圖Fig.1 Overall framework of the proposed model

3.1 邊緣信息

正如引言中所述,對(duì)比引入邊緣檢測的SCRN網(wǎng)絡(luò),可以發(fā)現(xiàn)復(fù)雜的背景和靠近邊緣的像素點(diǎn)很容易被誤檢測.顯著性檢測的難度隨著距離邊緣部分越近難度在逐漸變大,相反靠近顯著性圖片中心的像素點(diǎn)由于沒有背景的干擾,其數(shù)據(jù)分布的一致性導(dǎo)致其更容易檢測.基于此,本文提出了一種區(qū)別對(duì)待圖中像素點(diǎn)的SOD方法,通過邊緣檢測子網(wǎng)絡(luò)學(xué)習(xí)目標(biāo)的邊緣信息,然后將學(xué)習(xí)到的信息融合入顯著性檢測子網(wǎng)絡(luò),提高模型對(duì)邊緣部分的敏感程度并提升其準(zhǔn)確率.為了監(jiān)督學(xué)習(xí)所提取到的圖像邊緣信息,本文采用了一種傳統(tǒng)的數(shù)字圖像處理的方法距離轉(zhuǎn)換,生成邊緣真值圖.距離變換提供像素與某個(gè)圖像子集的距離.二值圖像的距離變換可以生成一張包含距離信息的圖像,其中前景的像素點(diǎn)的值對(duì)應(yīng)該點(diǎn)到背景的最短距離.傳統(tǒng)的距離變換一般有3種方式選取距離,歐氏距離,曼哈頓距離,和棋盤距離.并通過對(duì)照實(shí)驗(yàn)本文選取了歐氏距離.

取圖中任意兩點(diǎn)P,Q是其中P=(x,y),Q=(u,v)則距離定義如下:

曼哈頓距離:

D4(P,Q)=|x-u|+|y-v|

(1)

棋盤距離:

D8(P,Q)=max(|x-u|,|y-v|)

(2)

歐氏距離:

(3)

距離變換具體如下:

1)將真值圖的二值圖像中的像素點(diǎn)按照前景,背景分類(如和Ibg).

2)對(duì)于每一個(gè)像素點(diǎn)p,p∈Ifg,計(jì)算圖中前景Ifg每一個(gè)像素點(diǎn)對(duì)應(yīng)的值I(p).

3)使用距離公式(1)~公式(3)計(jì)算Ifg中每一個(gè)像素點(diǎn)到背景的Ibg的最小距離構(gòu)成集合I′.

4)對(duì)于圖中任意一點(diǎn)p,轉(zhuǎn)換后的灰度值計(jì)算如公式(4)所示.

(4)

將真值圖經(jīng)過上述距離變換得到包含邊緣細(xì)節(jié)信息的邊緣真值圖,用以監(jiān)督學(xué)習(xí)邊緣細(xì)節(jié)信息.對(duì)真值圖按照不同距離變換方法得到3組不同的邊緣真值圖,通過對(duì)比實(shí)驗(yàn),本文選擇歐氏距離變換得到的邊緣真值圖作為邊緣子網(wǎng)絡(luò)的標(biāo)簽信息進(jìn)行監(jiān)督學(xué)習(xí).歐式距離得到的效果也是最直觀,最符合人類視覺認(rèn)知的.

3.2 網(wǎng)絡(luò)模型

本文提出的模型以Resnet-50為其骨干網(wǎng)絡(luò),整體架構(gòu)如圖1所示.模型利用Resnet-50網(wǎng)絡(luò)高效提取多層特征的能力,獲得多層特征信息.不同特征層得到的特征信息通過1×1和3×3的卷積層壓縮通道數(shù),分別傳入邊緣檢測子網(wǎng)絡(luò)和顯著性檢測子網(wǎng)絡(luò)中,對(duì)稱的子網(wǎng)絡(luò)有著相同的網(wǎng)絡(luò)結(jié)構(gòu),再通過IEM對(duì)邊緣信息和顯著性信息融合,接著通過FFM將IEM融合后的信息與全局語音信息融合并獲取其層內(nèi)豐富的多尺度信息,信息流自頂向下傳遞融合層間信息,最終在顯著性檢測子網(wǎng)絡(luò)中生成顯著圖.

3.2.1 特征提取網(wǎng)絡(luò)

3.2.2 子網(wǎng)絡(luò)

雙分支網(wǎng)絡(luò)模型包含邊緣檢測子網(wǎng)絡(luò)和顯著性檢測子網(wǎng)絡(luò)兩個(gè)子網(wǎng)絡(luò),基于多層特征交互融合的兩個(gè)子網(wǎng)絡(luò)擁有相同的網(wǎng)絡(luò)結(jié)構(gòu).邊緣檢測子網(wǎng)絡(luò)與顯著性檢測子網(wǎng)絡(luò)各自獨(dú)立地學(xué)習(xí)邊緣信息和顯著性信息.子網(wǎng)絡(luò)中的IEM使得兩個(gè)子網(wǎng)絡(luò)信息交互融合,邊緣信息和顯著性信息可以互相補(bǔ)充.邊緣信息可以對(duì)顯著性信息進(jìn)行細(xì)節(jié)處的補(bǔ)充,也使得顯著性信息可以對(duì)邊緣信息進(jìn)行語義上的引導(dǎo).為了彌補(bǔ)在自頂向下過程中高層語義被稀釋的問題,本文加入了一個(gè)全局引導(dǎo)模塊(Global Guidance Module,GGM),使信息流在自頂向下解碼過程中不丟失太多上下文語義信息.IEM與GGM的輸出進(jìn)入FFM,進(jìn)一步提取特征層內(nèi)的不同尺度信息,從層內(nèi)角度豐富特征層尺度信息.最終融合后的信息在顯著性檢測子網(wǎng)絡(luò)最淺層生成最終顯著圖.

3.2.3 信息交互模塊

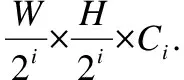

多層特征融合是一種有效提升顯著性檢測準(zhǔn)確性的方法.傳統(tǒng)的方法旨在融合層間信息,而邊緣信息與顯著性信息的融合使得模型準(zhǔn)確率得到進(jìn)一步提升.本文設(shè)計(jì)IEM如圖2所示,其中IEM有兩個(gè)輸入,其中一個(gè)輸入來自骨干網(wǎng)絡(luò)當(dāng)前特征層的特征輸入,另一個(gè)輸入來自相對(duì)應(yīng)的另一子網(wǎng)絡(luò)相同層的IEM的輸出.IEM可以被簡單描述為:

(5)

(6)

(7)

圖2 信息交互模塊和特征聚合模塊框架圖Fig.2 Structure of the information exchange module and feature fusion module

3.2.4 特征聚合模塊

在邊緣信息和顯著性信息逐層融合后,每一層融合后的特征將分別被送入相應(yīng)層的FFM中.FFM設(shè)計(jì)用以自頂向下傳輸信息并提取特征層內(nèi)的多尺度信息.FFM具體網(wǎng)絡(luò)結(jié)構(gòu)參見圖2,在FFM中其輸入是上一個(gè)特征層的FFM的輸出,該層的IEM的輸出以及GGM的輸出,模塊可以用公式(8)定義:

Mi=f′(Mi-1,G,Ni)

(8)

其中,Mi表示第i個(gè)FFM的輸出特征圖,Ni表示第i個(gè)IEM的輸出,G表示GGM的輸出.f′(·)表示FFM從輸入到輸出的映射關(guān)系.特征圖Mi-1首先通過因子為2的上采樣使得特征圖與當(dāng)前特征層相同尺寸大小,然后一個(gè)3×3卷積層和批歸一化層接在上采樣后,GGM也通過上采樣到當(dāng)前特征層相同尺寸并同樣接上卷積層和批歸一化層.所得的特征圖與IEM的輸出特征圖Ni相級(jí)聯(lián).級(jí)聯(lián)后的融合特征加上兩組卷積和批歸一化層進(jìn)行通道壓縮和特征學(xué)習(xí).具體描述如下:

(9)

(10)

(11)

在大多數(shù)多層特征融合網(wǎng)絡(luò)中,這個(gè)初始的融合特征即被用作最終的融合特征,但其語義特征提取的效果并不理想,因?yàn)槠淙鄙俨煌叨鹊慕换?金字塔池化模塊具有有效的語義特征提取的能力,本文用尺度為2,4兩種尺度對(duì)融合后特征進(jìn)行下采樣以提取不同尺度的語義信息.下采樣后的特征將其與融合后的初始特征進(jìn)行級(jí)聯(lián).得到的特征圖經(jīng)過激活函數(shù),最終得到FFM輸出.具體數(shù)學(xué)表述如下:

(12)

(13)

(14)

其中Relu(·)表示激活函數(shù),Down代表下采樣操作,下標(biāo)代表下采樣的倍數(shù),?表示逐元素加操作.

3.2.5 全局引導(dǎo)模塊

本文提出的網(wǎng)絡(luò)結(jié)構(gòu)是由一個(gè)自底向上的主干網(wǎng)絡(luò)和一個(gè)自頂向下的解碼網(wǎng)絡(luò)構(gòu)成.這一方式配合FFM可以有效提升模型捕獲多尺度和細(xì)節(jié)特征的能力.但在解碼過程中,全局語義信息會(huì)在過程中逐層稀釋,所以本文在每層全局聚合模塊中引入了GGM輸出的全局語義信息.如圖1所示,GGM在整體結(jié)構(gòu)中提供了一個(gè)自頂向下的全局語義信息流,對(duì)模型的訓(xùn)練起到全局引導(dǎo)作用.

(15)

實(shí)際上,GGM增強(qiáng)了模型對(duì)高層語義信息的保留,對(duì)不同尺度目標(biāo)的捕捉能力,進(jìn)而提升了網(wǎng)絡(luò)的性能.

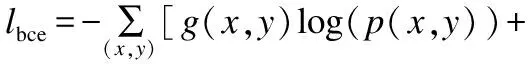

3.3 損失函數(shù)

本文的訓(xùn)練損失函數(shù)定義為所有迭代輸出的損失和:

L=(1-α)lbce(S,GT)+αlbce(E,B)

(16)

lbce是二元交叉熵?fù)p失.S是本文設(shè)計(jì)的模型最終得到的顯著圖,此處E表示本文模型得到的邊緣誤差圖,B是通過距離變換算法得到的邊緣圖,GT代表顯著性真值圖.α是超參數(shù),代表邊緣信息在最終的結(jié)果中的影響程度.其中本文使用二元交叉熵計(jì)算邊緣損失,二元交叉熵作為損失函數(shù)廣泛應(yīng)用在二分類和分割中,其定義為:

(17)

其中g(shù)(x,y)∈[0,1]代表像素點(diǎn)(x,y)的標(biāo)簽值,p(x,y)∈[0,1]代表顯著性檢測在該點(diǎn)的預(yù)測值.顯著性檢測子網(wǎng)絡(luò)和邊緣檢測子網(wǎng)絡(luò)都是基于多層特征融合,他們分別學(xué)習(xí)顯著性信息和邊緣信息,邊緣檢測子網(wǎng)絡(luò)只在訓(xùn)練時(shí)起作用,推導(dǎo)時(shí)不參與計(jì)算,降低了網(wǎng)絡(luò)在推導(dǎo)過程中的計(jì)算量.顯著性信息和邊緣信息通過IEM充分融合,邊緣檢測子網(wǎng)絡(luò)經(jīng)IEM作用于顯著性檢測子網(wǎng)絡(luò),引導(dǎo)生成的顯著圖更加注意邊緣信息,幫助生成邊緣完整的顯著圖.最終的實(shí)驗(yàn)結(jié)果顯示本文的模型在低對(duì)比度的區(qū)域以及靠近邊緣的區(qū)域都取得了不錯(cuò)的效果.

4 實(shí)驗(yàn)和結(jié)果分析

本文實(shí)驗(yàn)在DUTS-TR訓(xùn)練集上的10553張尺寸大小為320×320的圖片上進(jìn)行訓(xùn)練,為了避免過擬合,提高模型魯棒性,本文對(duì)訓(xùn)練數(shù)據(jù)進(jìn)行了數(shù)據(jù)增強(qiáng)處理,包括隨機(jī)水平翻轉(zhuǎn),隨機(jī)旋轉(zhuǎn)和隨機(jī)顏色抖動(dòng).本文采用ImageNet預(yù)訓(xùn)練權(quán)重骨干網(wǎng)絡(luò)的初始參數(shù),其余參數(shù)隨機(jī)初始化.本文實(shí)驗(yàn)在單卡平臺(tái),NVIDIA GTX TITAN Xp GPU上進(jìn)行訓(xùn)練,采用Pytorch深度學(xué)習(xí)框架,整個(gè)實(shí)驗(yàn)訓(xùn)練過程的epoch設(shè)為50,BatchSize設(shè)為8,權(quán)重衰減為5e-4,訓(xùn)練學(xué)習(xí)率設(shè)為1e-3.

4.1 數(shù)據(jù)集和評(píng)價(jià)標(biāo)準(zhǔn)

為了評(píng)估本文模型,在5個(gè)常用公開數(shù)據(jù)集上進(jìn)行了實(shí)驗(yàn),包括DUTS[31],DUT-OMRON[32],HKU-IS[33]和ECSSD[34]和PASCAL-S[35].其中DUTS包含10553張訓(xùn)練圖片和5019張測試圖像,是目前最大的顯著性檢測數(shù)據(jù)集.該數(shù)據(jù)集包含大量復(fù)雜場景.DUT-OMRON包含5168幅背景復(fù)雜內(nèi)容變換大的圖像.ECSSD由1000幅圖像組成,該數(shù)據(jù)集包含大量復(fù)雜結(jié)構(gòu)的多尺度圖片.HKU-IS包含4447個(gè)復(fù)雜的場景圖,其中包含多個(gè)斷開連接的對(duì)象,空間分布相對(duì)不同,其中低對(duì)比度的前景和背景使得網(wǎng)絡(luò)在該數(shù)據(jù)集更難分割.PASCAL-S由850幅具有挑戰(zhàn)性的圖像組成.

對(duì)于顯著性檢測任務(wù),通常采用4項(xiàng)指標(biāo)評(píng)價(jià)模型性能,分別是:最大F度量(MaxF),結(jié)構(gòu)性度量(S-measure),平均絕對(duì)誤差(Mean Absolute Error,MAE)和準(zhǔn)確率—召回率(Precision-Recall,PR)曲線.F-measure是準(zhǔn)確率和召回率的加權(quán)調(diào)和平均:

(18)

(19)

式(19)中MAE表示平均絕對(duì)誤差,G,S分別表示映射到[0,1]區(qū)間的真值圖和顯著圖,H和W是對(duì)應(yīng)的長和寬.

S-measure[34]通過圖像質(zhì)量評(píng)價(jià)領(lǐng)域的結(jié)構(gòu)相似性指標(biāo),計(jì)算得到面向區(qū)域和面向?qū)ο蟮慕Y(jié)構(gòu)相似性.S-maeasure是目標(biāo)感知和區(qū)域感知的結(jié)構(gòu)相似性,計(jì)算公式如式(20)所示:

Sm=αSo+(1-α)Sr

(20)

式(20)中α取0.5,Sr,So分別表示區(qū)域感知和目標(biāo)感知,所得到的Sm越大,表示顯著性圖與真值圖之間的空間結(jié)構(gòu)越相似.PR曲線是顯著性評(píng)價(jià)的一項(xiàng)整體指標(biāo).刻畫準(zhǔn)確率和召回率之間的關(guān)系.

4.2 性能對(duì)比

圖3 本文方法與其他12種方法的視覺對(duì)比圖Fig.3 Visual comparison of the proposed method with eight other SOD methods

4.3 消融實(shí)驗(yàn)

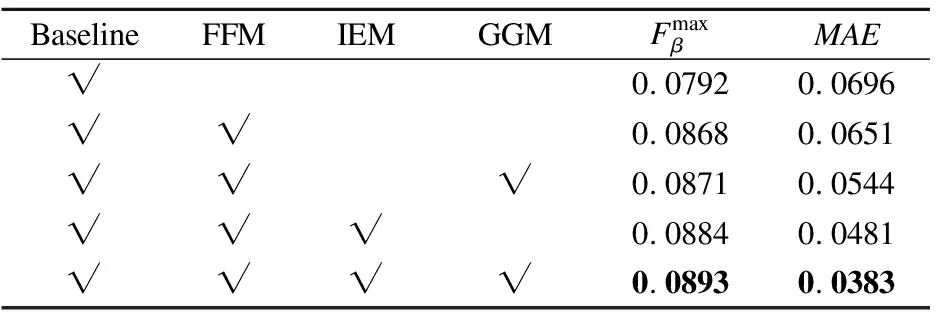

為了進(jìn)一步驗(yàn)證FFM、IEM和GGM的有效性,本文對(duì)比了添加模塊前后的檢測結(jié)果,實(shí)驗(yàn)結(jié)果如圖6所示.本文將骨干網(wǎng)絡(luò)經(jīng)過簡單級(jí)聯(lián)進(jìn)行特征融合的網(wǎng)絡(luò)稱為Baseline網(wǎng)絡(luò),作為本文實(shí)驗(yàn)對(duì)照組.通過逐個(gè)添加模塊得到的可視化結(jié)果圖.從圖6(c)可以看出僅使用Baseline網(wǎng)絡(luò)得到的顯著圖包含很多干擾,細(xì)節(jié)部分大量缺失.從圖6(d)可以看出FFM的加入可以有效提高網(wǎng)絡(luò)對(duì)于尺度信息的捕捉,但是依然難以準(zhǔn)確區(qū)分低對(duì)比度和細(xì)節(jié)邊緣區(qū)域.從圖6(e)可以看出增加GGM提高了網(wǎng)絡(luò)對(duì)于全局信息的理解,提高了顯著區(qū)域預(yù)測的準(zhǔn)確度和對(duì)背景的抗干擾能力.IEM的加入使得網(wǎng)絡(luò)對(duì)邊緣具有更好的感知能力.定量分析模型包含所有模塊如表2所示,即同時(shí)加入FFM、IEM和GGM時(shí)模型取得了最好的性能表現(xiàn),缺少任何一個(gè)都會(huì)造成一定的精度損失,因此,所有模塊的共同作用使得顯著性檢測結(jié)果最佳.

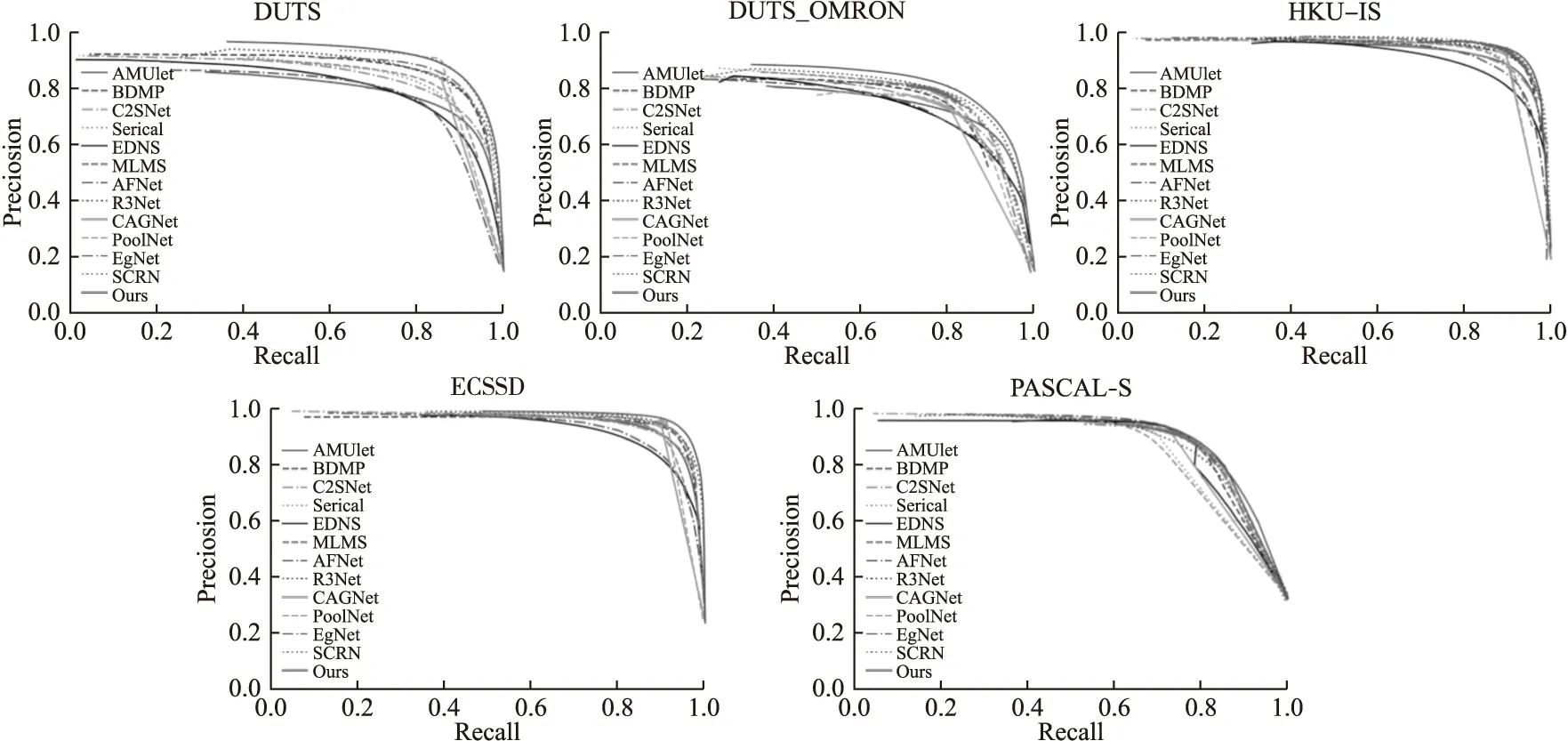

圖4 本文方法與其他12種方法的PR曲線圖Fig.4 Precision-Recall curves of our models and other typical state-of-the-art models on five SOD datasets

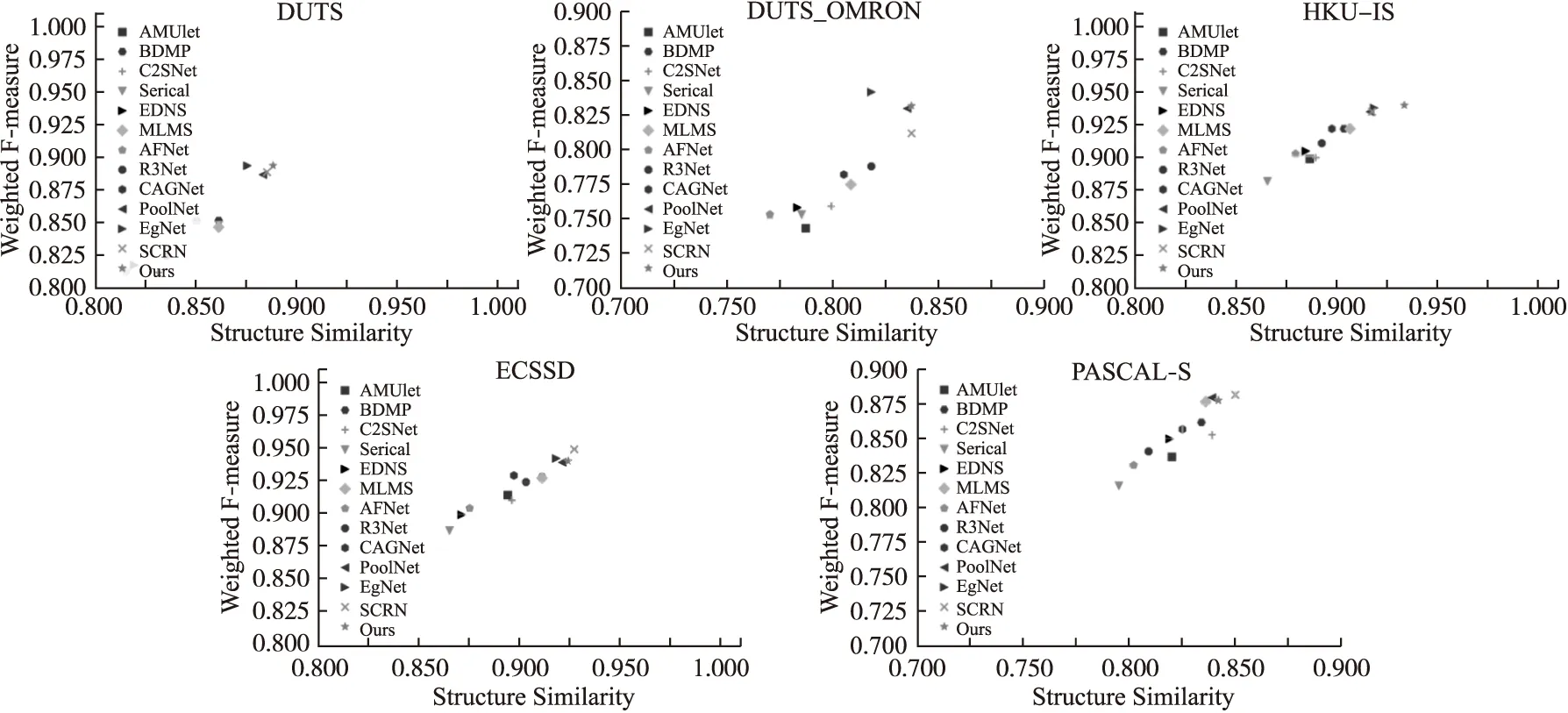

圖5 本文方法與其他12種方法的F度量和結(jié)構(gòu)相似度得分圖Fig.5 Weighted F-measure and structure similarity scores of our models and other typical state-of-the-art models on five SOD datasets

表2 在DUTS數(shù)據(jù)集上的不同模塊消融實(shí)驗(yàn)Table 2 Ablation experiments results around different module on DUTS

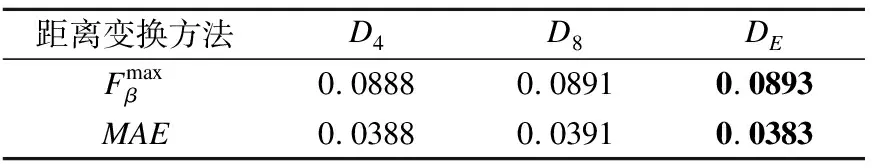

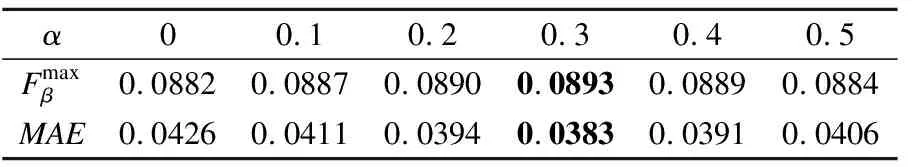

此外,本文對(duì)比了不同距離變換方法,得到的結(jié)果如表3所示,根據(jù)實(shí)驗(yàn)結(jié)果,本文在距離變換中選取了歐氏距離作為本文的邊緣真值圖生成方法.對(duì)于損失函數(shù)公式(16)中的超參數(shù)α,本文設(shè)計(jì)了不同的值加以實(shí)驗(yàn),實(shí)驗(yàn)結(jié)果如表4所示.最終超參數(shù)α取0.3得到最好的效果.

表3 不同距離變換下得到的實(shí)驗(yàn)結(jié)果Table 3 Ablation experiments results around different function of distance transformation

表4 超參數(shù)α不同取值下的實(shí)驗(yàn)結(jié)果Table 4 Different weights of α in loss function

圖6 不同模塊效果對(duì)比圖Fig.6 Visual comparisons with different combinations

5 總 結(jié)

針對(duì)現(xiàn)有顯著性檢測方法對(duì)圖像的低對(duì)比度區(qū)域和邊緣區(qū)域存在誤檢測的問題,提出了一種包含邊緣檢測子網(wǎng)絡(luò)和顯著性檢測子網(wǎng)絡(luò)的雙分支網(wǎng)絡(luò)模型.在自頂向下的信息流傳遞過程中,通過IEM和FFM,將兩個(gè)子網(wǎng)絡(luò)各自學(xué)到的特征信息逐層融合,使得邊緣信息可以對(duì)顯著性信息進(jìn)行細(xì)節(jié)處的補(bǔ)充,也使得顯著性信息可以對(duì)邊緣信息進(jìn)行語義上的引導(dǎo),使得模型對(duì)邊緣區(qū)域敏感,解決了邊緣易誤識(shí)別的問題.在GGM模塊中,利用高層信息對(duì)底層信息的指導(dǎo)作用,豐富了底層信息中的上下文信息,緩解了在自頂向下傳遞過程中高層語義信息的淡化現(xiàn)象,實(shí)現(xiàn)了高低層特征的有效融合,提高特征流的完整性.此外,提出的IEM和FFM從融合層間信息轉(zhuǎn)換到充分挖掘?qū)觾?nèi)尺度信息,設(shè)計(jì)了金字塔池化模塊在其中,學(xué)習(xí)層內(nèi)豐富多尺度信息,提升了網(wǎng)絡(luò)對(duì)顯著性物體尺度的魯棒性.在5個(gè)公開數(shù)據(jù)集上的大量實(shí)驗(yàn)從定性和定量評(píng)價(jià)的角度驗(yàn)證了提出的方法都有顯著的性能提升.